唠嗑

我本来一开始打算用源码跑的,然后发现越捣鼓越麻烦,最后还是用Python去跑,但是会踩一个坑,因为要从HuggingFace下载一个很小的模型,下不下来就会报错,我把这个丢到蓝奏云上去,如果你的环境不是Python3.11那你可以看我之前的文章通过MiniConda来管你多个Python环境

MiniConda的使用:尝试使用Miniconda来管理Python环境(Windwos)

Ollama的使用:捣鼓一下ollama的使用(Windows)

Open-WebUI需要的模型:蓝奏云 提取码:bb5v

Open-WebUI GIthub:https://github.com/open-webui/open-webui

快速运行

参考官方文档来,就两个命令

pip install open-webuiopen-webui serve出错

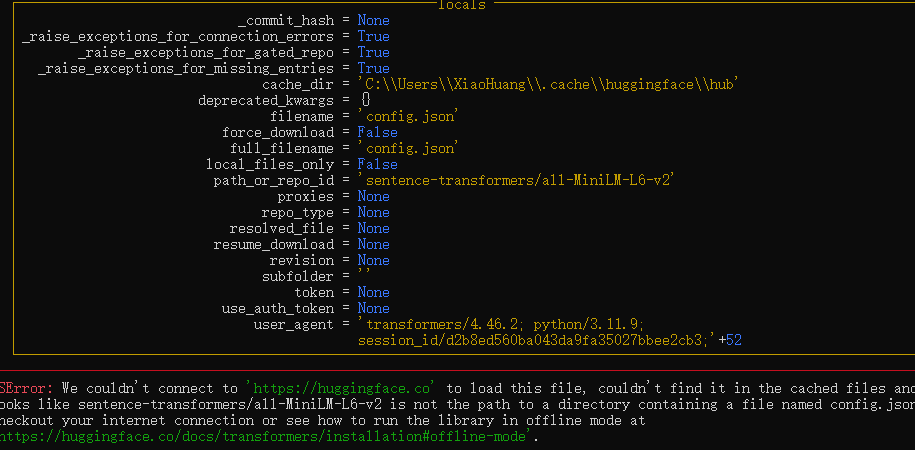

如果你在运行的时候出现了和我一样的错误

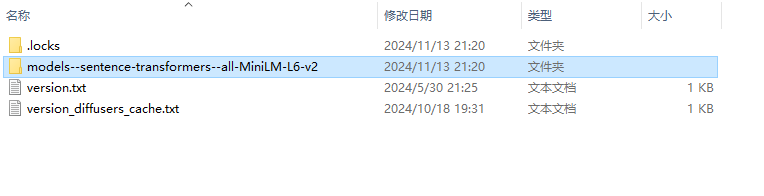

这时候就需要下载所需要的模型,放到路径:C:\Users\你的用户名\.cache\huggingface\hub

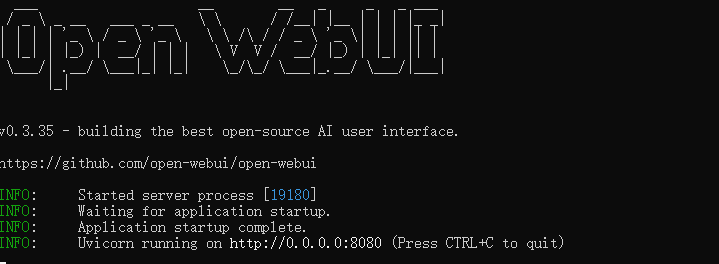

然后重新运行即可成功跑起来open-webui!

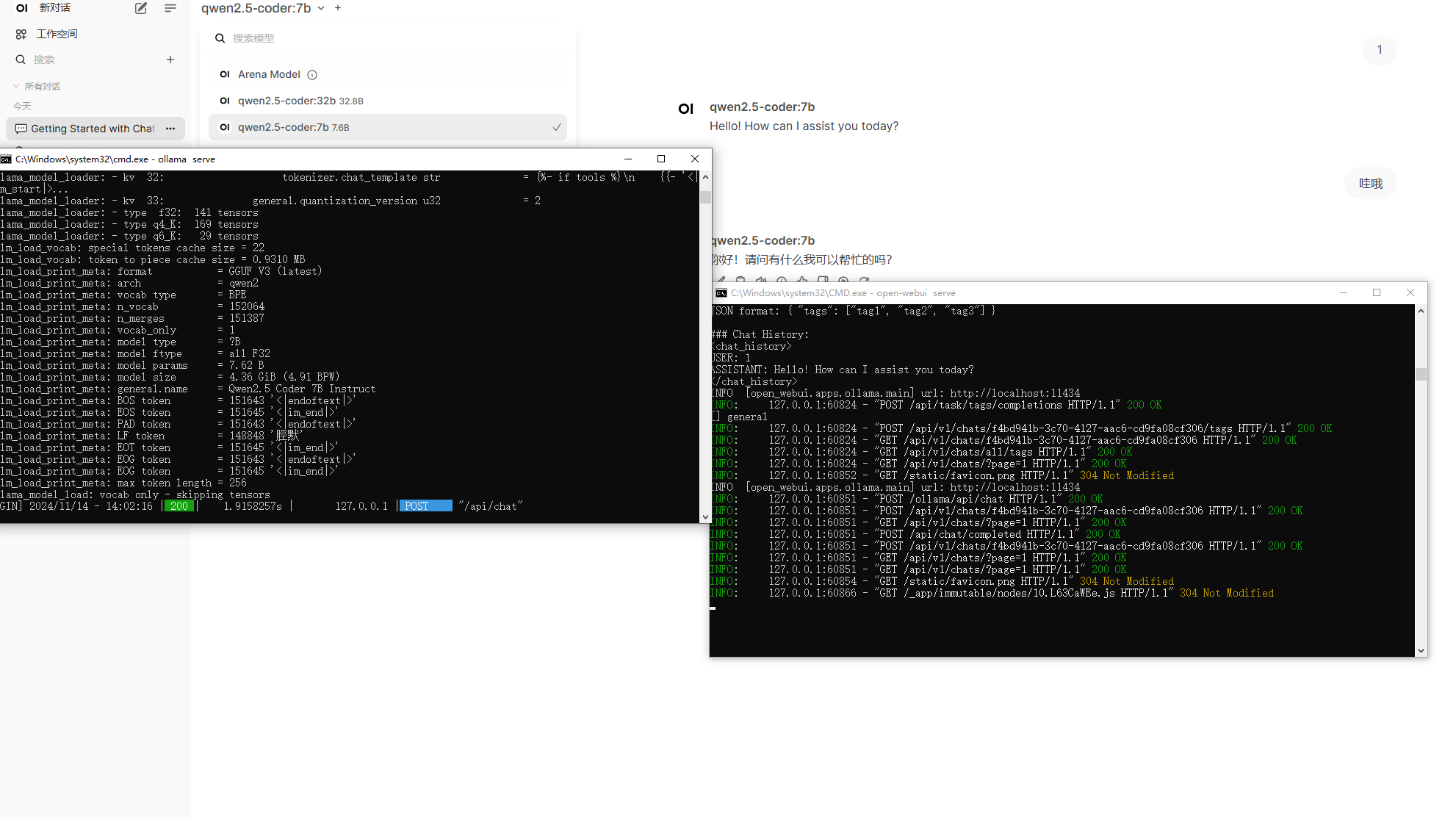

再启动Ollama就行

ollama serve就可以开始使用啦!